“人工智能”数据投喂泄露隐私,算法生成虚假信息,大模型时代怎么防范安全风险?

今天,很高兴为大家分享来自环球网的数据投喂泄露隐私,算法生成虚假信息,大模型时代怎么防范安全风险?,如果您对数据投喂泄露隐私,算法生成虚假信息,大模型时代怎么防范安全风险?感兴趣,请往下看。

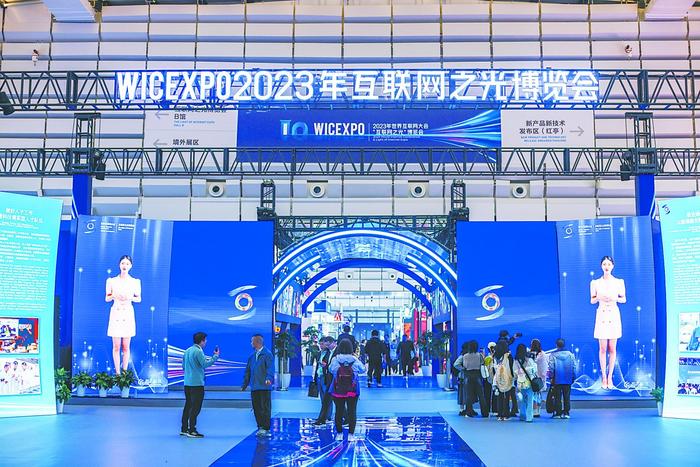

[环球时报赴乌镇特派记者 刘扬 李炫旻]随着以ChatGPT为代表的生成式人工智能大模型持续火爆,全球科技公司、科研机构纷纷布局自己的大模型。生成式人工智能与大模型的快速发展,也给网络安全带来全新挑战。在8日开幕的2023年世界互联网大会乌镇峰会上,国内外安全专家纷纷从各自角度阐释对人工智能大模型时代网络安全新挑战的理解,《环球时报》记者在“互联网之光”博览会上看到大部分展台都有大模型相关展品,其中不乏“以魔法打败魔法”的大模型安全整体解决方案。

人工智能大模型带来哪些挑战

在9日举行的世界互联网大会乌镇峰会“人工智能赋能产业发展论坛”上,中外专家共同发布了《发展负责任的生成式人工智能研究报告及共识文件》(以下称报告)。报告提到,近年来,生成式人工智能在文本、代码、图像、音视频等方面的理解与生成取得突破性进展,有望大幅提升社会生产力。与此同时,报告也用专门的一章解读了生成式人工智能带来的风险。

报告称,生成式人工智能技术在迭代升级的同时也放大了技术安全风险。数据方面,数据投喂带来价值偏见、隐私泄露、数据污染等问题:训练数据固有偏见导致模型产生偏见内容;海量训练数据扩大了数据安全和隐私保护风险。算法方面,算法模型生成特性及安全漏洞会引发“幻觉”或虚假信息、模型遭受攻击等风险。报告还提到两大更深层次的风险:生成式人工智能重构人机关系可能带来科技伦理失范;强大的任务处理能力,容易导致人的思维依赖;生成式人工智能凸显发展的不均衡引发人类社会发展差距进一步拉大。

《环球时报》记者在“互联网之光”博览会上也感受了生成式人工智能可能带给普通人的安全风险。在一个聚焦青少年编程的公司展台,记者体验“看到的也未必是真实的”换脸揭秘实验。在机器前站几秒钟之后,AI就根据记者的外貌特征提供了两个换脸模型,一个是秒变“憨豆先生”,另一个是满脸大胡子。据展台工作人员介绍,这就是对青少年进行“换脸”风险的科普。

一名已经第十次参加世界互联网大会的中国网络安全专家对《环球时报》记者表示,前几年我们关注云安全、大数据安全、物联网安全,但今天大模型安全是一个必须重视的话题。

大模型如何保障重大活动安保

公开报道显示,2012年伦敦奥运会,多家媒体遭遇网络攻击;2016年里约奥运会遭到大规模APT袭击、DDoS攻击;2018年平昌冬奥会更是遭遇了奥运史上最大的网络安全事故。《环球时报》记者在“互联网之光”博览会上了解到,前不久成功举办的杭州亚运会,不仅是一场体育成绩、大型活动组织的比拼,更是一场网络安全攻防对抗的较量。

《环球时报》记者在“互联网之光”博览会现场看到一个巨大的显示屏,以动态形式直观地演示杭州亚运会网络安保过程中的态势感知与快速应对能力。据安恒信息副总裁梁浩介绍,现场展示的MSS亚运天穹——新一代主动防御运营中心是服务于杭州亚运安保防护体系的综合运营中心,它实际上是结合本次亚运会的建设范围来进行定义的,涉及整个亚运会88个竞赛和非竞赛场馆,相关安全细节、措施、问题都可以通过这个运营中心的视角及时掌握。如果有需要随时能够查看到具体场馆里相关的IT机房,检查安全防护设备在哪个槽位,如有异常、中断、告警,都能够及时反馈处置。

据介绍,杭州亚运会的运动员人数、赛事项目规模和场馆数量大概4倍于北京冬奥会,如果按照传统方式可能需要数千人才能完成安保,但实际上本次亚运会现场安保只有400多人,如何在这么大范围内用较少的人员去满足安保需求,其实就是用了大模型技术。“我们将大模型在安全领域进行了结合,帮助现场分析人员快速辅助进行研判,并提供处置方案。特别是在重点活动保障方面,对时效性要求特别高,比如在杭州亚运会期间观测到有超过2600万次的网络攻击,在整个拦截过程中更多是用了自动化的关联和阻断技术,其中也用到了人工智能和大模型的能力。”

如何“用魔法打败魔法”

为了应对生成式人工智能与大模型带来的挑战,国内网络安全领域的头部公司也纷纷在“互联网之光”博览会上展出解决方案。《环球时报》记者印象最深的就是用AI对付AI、“用魔法打败魔法”。比如在奇安信展台,记者看到“大模型卫士”提供的一系列强大防护能力。阿里巴巴展台也提出“大模型安全全链路解决方案”。

参加本次世界互联网大会的360集团创始人周鸿祎在接受《环球时报》采访时表示,所有数字化技术必然都是双刃剑,有软件就会有漏洞,有漏洞就会被攻击,人工智能大模型也不可避免。周鸿祎认为,人工智能面临的安全问题可分为三级:初级/近期问题、中级/中期问题和高级/长期问题。初级/近期问题是技术攻击问题,也就是网络攻击、漏洞攻击、数据攻击问题,特别是提供给大模型不好的数据或污染它的训练数据,可能会导致结果出错。这类问题相对比较好解决。比较难解决的是中级/中期问题,主要涉及内容安全。例如大模型可以成为人们很好的帮手,也能成为坏人的工具。它可以帮一个水平不怎么样的黑客写更好的攻击代码、诈骗邮件。如何让它的内容更加可控?如何防止人工智能大模型不作恶?这已经超越技术范畴了。尽管现在有人为大模型做了内置的所谓“安全护栏”,但它很容易遭到注入攻击或算法攻击。这类问题的解决思路之一是开发小规模模型,专门针对不怀好意的提问,让大模型在回答用户问题前先用小模型过滤。

周鸿祎认为,从高级/长期的问题来看,大模型可以把人类所有知识融会贯通,再来和人类做交流、做提示。但对于未来万一大模型能力超越人类后,还能不能甘于做人类的工具,周鸿祎表示,“我的一个观点是,这些技术带来的挑战最终还得靠技术来解决,技术自身会不断进化。不能因为未来还没有发生的问题就不发展相关技术”。

在8日举行的2023年世界互联网大会蓝皮书新闻发布会上,中国网络空间研究院网信理论与战略研究所副所长姜淑丽介绍说,中国坚持安全与发展并重的原则,为生成式人工智能发展营造创新生态,同时重视防范风险,制定人工智能监管规则。2023年7月,中国发布《生成式人工智能服务管理暂行办法》,是全球范围内首部针对生成式人工智能的管理办法。同时,中国发起“全球人工智能治理倡议”,明确提出发展人工智能坚持相互尊重、平等互利的原则。

责任编辑:刘德宾

好了,关于数据投喂泄露隐私,算法生成虚假信息,大模型时代怎么防范安全风险?就讲到这。